Sam Altmans Big-Money-Deal

History eines Niedergangs

Januar 2024 Der Machtkampf

Der Machtkampf

Wildwest in der KI-Branche. Sam Altman nach Rauswurf wieder Chef bei OpenAI. Business sticht Gemeinwohl.

Juni 2024 Der Machtkampf: Mission Completed

Der Machtkampf: Mission Completed

Palastrevolte bei OpenAI endgültig gescheitert. Mitgründer und Top-Entwickler Ilya Sutskever verlässt OpenAI. De-Facto-Alleinherrschaft für Sam Altman und die Milliarden von Microsoft.

Oktober 2024 Sam Altman allein zu Hause

Sam Altman allein zu Hause

Big Money First. Die Transformation eines dem Fortschritt für die Menschen verschriebenen Unternehmens zu einer Profit-Benefit-Corporation

Anthropic, offensichtlich entsetzt über die Rolle, die ihr Chatbot-System Claude bei der Menschenraub-Spezialoperation Donald Trumps, der Entführung von Venezuelas Präsident Maduro, gespielt hat, wollte daraufhin seine Verträge mit dem Pentagon ändern. Dem Militär sollte explizit untersagt werden, Anthropics KI-Modell Claude für Massenüberwachungen von Bürgern und für autonome tödliche Waffensysteme (z.B. Killerdrohnen) einzusetzen. Trump hielt das für unakzeptabel, erklärte Anthropic zum Sicherheitsrisiko, beschimpfte das Unternehmen als „Radical Left Woke Company“ und ordnete an, dass alle Bundesbehörden die Nutzung von Anthropic-Software innerhalb von sechs Monaten einstellen müssten. Das geschah am 27.2.2026.

Anthropic, offensichtlich entsetzt über die Rolle, die ihr Chatbot-System Claude bei der Menschenraub-Spezialoperation Donald Trumps, der Entführung von Venezuelas Präsident Maduro, gespielt hat, wollte daraufhin seine Verträge mit dem Pentagon ändern. Dem Militär sollte explizit untersagt werden, Anthropics KI-Modell Claude für Massenüberwachungen von Bürgern und für autonome tödliche Waffensysteme (z.B. Killerdrohnen) einzusetzen. Trump hielt das für unakzeptabel, erklärte Anthropic zum Sicherheitsrisiko, beschimpfte das Unternehmen als „Radical Left Woke Company“ und ordnete an, dass alle Bundesbehörden die Nutzung von Anthropic-Software innerhalb von sechs Monaten einstellen müssten. Das geschah am 27.2.2026.

Der Super-Deal

Am gleichen Tag, dem

27.2.2026, gab OpenAI einen neuen Großauftrag mit dem Pentagon über 200 Millionen US-Dollar bekannt. Und das ist nur der Anfang. Der direkte Pentagon-Auftrag ist Türöffner für OpenAI, um sich als unverzichtbarer technologischer Partner des US-Staates zu positionieren. Anthropic steht nun politisch isoliert da.

Sam Altman war schon vorher in den Startlöchern. Er hatte schon die Gelegenheit genutzt, um Verträge mit dem Pentagon abzuschließen, die weniger restriktiv waren. Leise wurde die Formulierung gestrichen, die den Einsatz für militärische Nutzung und Kriegsführung untersagte, verkauft als „Beitrag zur nationalen Sicherheit“, so Altmans Selbsternennung zum nationalen Helden. Am gleichen Tag, an dem Trumps Zorn Anthropic traf, verkündete er die neue Freundschaft als strategischer Partner der US-Regierung. Das kam überhaupt nicht gut.

Sam Altman war schon vorher in den Startlöchern. Er hatte schon die Gelegenheit genutzt, um Verträge mit dem Pentagon abzuschließen, die weniger restriktiv waren. Leise wurde die Formulierung gestrichen, die den Einsatz für militärische Nutzung und Kriegsführung untersagte, verkauft als „Beitrag zur nationalen Sicherheit“, so Altmans Selbsternennung zum nationalen Helden. Am gleichen Tag, an dem Trumps Zorn Anthropic traf, verkündete er die neue Freundschaft als strategischer Partner der US-Regierung. Das kam überhaupt nicht gut.

Es hagelte Proteste, bei einem Town Hall-Meeting (am 4.März 2026, Bericht The Guardian) ging es hoch her. Viele OpenAI-Mitarbeitende beteiligten sich an der Unterzeichnung eines offenen Briefes mit einer Solidaitätsadresse an Anthropic für seine konsequente und unnachgiebige Haltung, während Sam Altman Eiertänze vor seiner eigenen Belegschaft vorführte und zugeben musste, dass die Angelegenheit schon „opportunistisch und schlampig“ gewirkt habe, aber doch gerechtfertigt, denn ein weit schlimmeres Ereignis konnte verhindert werden wie ein drohender Exklusiv-Deal mit der weit skrupelloseren Firma xAI von Elon Musk. Seinen Mitarbeitenden soll Altman an den Kopf geworfen haben „You do not get to make operational decisions (ihr bekommt dazu kein Mitspracherecht)“ und basta.

Aus der Entourage des US-Präsidenten ist lautstark zu hören, dass jemand, der dem Militär ethische Vorschriften machen wolle, die Verteidigungsfähigkeit der USA schwäche und zu Recht als Risiko für die nationale Sicherheit einzustufen sei, denn dem amerikanischen Militär müssten ohne ideologische Schranken die besten Werkzeuge zur Verfügung stehen (zeigen, was dahinter steht).

In die Auseinandersetzung ist Trumps Schwiegersohn, Chef-Unterhändler und -Deal Maker Jared Kushner involviert. Sein Bruder Joshua ist mit dem von ihm gegründeten Thrive Capital-Fonds nach Microsoft der größte Investor bei OpenAI und eng mit Jareds Investmentfonds Affinity Partners verbandelt. Zahlreiche Kritiker meinen, dass die Beschädigung von Anthropic durch die Einstufung als nationales Risiko der Konkurrenz OpenAI zugute kommt und damit die Kushner-Family massiv von der Wertsteigerung OpenAIs profitiert. Es geht mal wieder um Big Money.

Anthropic darf sich derweil an einem hohen Respekt vieler Mitarbeitenden von HighTech-Firmen erfreuen. Doch das Geschäft hat OpenAI gemacht.

Kultureller Abstieg

OpenAI mag durch den Pentagon-Deal finanziell gewonnen und einen strategischen Vorteil erreicht haben, aber hat dafür kulturell einen hohen Preis gezahlt. Damit wollten viele Mitarbeitende nichts zu tun haben.

OpenAIs Dissidenten

Dario und Daniela Amodai verließen schon im Dezember 2020 OpenAI und gründeten Anthropic

Andrej Karpathy Mitbegründer, ehem. Chief Scientist, Februar 2024, gründete Eureka Labs

Ilja Sutskever Mitbegründer, ehem. Chief Scientist, Mai 2024, gründete Safe Superintelligence INC (SSI)

Jan Leike ehem. Alignment Chef, Mai 2024, wechselte zu Anthropic

John Schulman Gründungsmitglied, wechselte August 2024 zu Anthropic

Mira Murati ehemals CTO, September 2024, gründete Thinking Machine Labs

Bob McGrew, ehem. Chief Research Officer, wechselte zeitgleich zu Mira Muratis Startup.

Barret Zoph, ehem. Vice President Research, ebenfalls September 2024 zu Murati und dort als CTO tätig.

Caitlin Kalinowski, OpenAIs Hardware-Chefin,kündigte am 7. März 2026 unmittelbar nach dem Pentagon-Deal OpenAIs, mit ihr mehrere Ingenieure aus dem Robotik-Kernteam.

Max Schwarzer, ehem. Vice President Research, kündigte wenige Stunden nach Bekanntgabe des Pentagon-Deals ( März 2026) und nawechselte zu Anthropic.

Stand März 2026

Beachtlich ist der Exodus ehemals führender Personen. Nicht viel ist übrig geblieben von der hehren Gründungsabsicht, man wolle die Vorteile dieser Technologie der gesamten Menschheit zugute kommen lassen. Die sehr intrigant betriebene Umstrukturierung von OpenAI von einer Non-Profit-Struktur zu einer Profit-Benefit-Corporation hatte schon lange den Weg für den kulturellen Abgstieg geebnet. Das nassforsche Vorgehen Altmans bei der Wegbereitung für schnelles Geldverdienen, unter Hintanstellung der Sicherheitsbedenken, hatte schon Gründungsmitglieder des Unternehmens verschreckt. Sie und eine Reihe weiterer Spitzenleute sind ausgestiegen und haben Firmen gegründet, die es besser machen wollen, zurück zu den Grundsätzen des Gründungsmanifests:

- Künstliche Intelligenz zum Wohle aller, eine Technik, die der ganzen Menschheit dient, nicht nur Aktionären oder einzelnen Staaten,

- Gemeinnützigkeit vor Profit,

- Offenheit aller Forschungsergebnisse und weltweite Zusammenarbeit,

- Sicherheit als Priorität, Vermeidung existenzieller Risiken und unkontrollierbarer Entwicklungen.

Was daraus geworden ist: Statt Non-Profit ein 800 Börsenmilliarden schwerer High-Tech-Gigant, Geheimhaltung statt Open Source und vom Geweinwohl zum Partner des „Kriegsministeriums“. Das waren nicht die Ideale der Gründer und vieler engagierter Mitarbeitenden. Viele Entwicklerinnen und Entwickler, die sich der ursprünglichen „Safe AI“-Mission von OpenAI verschrieben hatten, sehen in Anthropic oder Thinking Machines Lab (Startup von Mira Murati) nun die integeren Alternativen.

OpenAI ist es in den letzten Jahren trotz der gigantischen Börsenbewertung finanziell nicht gut gegangen. Das Chatbot-Geschäft dümpelt vor sich hin. 2023 standen einem Umsatz (nicht Gewinn!) von knapp zwei Milliarden US-Dollar fünf Milliarden Verlust gegenüber, 2024 waren es knapp vier Milliarden Umsatz bei sieben Milliarden Verlust und 2025 waren 11 Milliarden Umsatz von 14 Milliarden Verlust begleitet. Mit dem Verkauf von APIs (Schnittstellen für den Chatbot-Einbau in Anwendungsprogramme) hat man inzwischen auch nur eine Milliarde Umsatz gemacht.

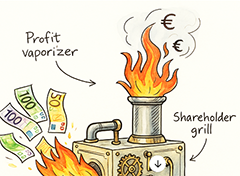

Geldverbrennungsmaschine

Diese Geldverbrennungsmaschine wird dennoch an der Börse mit 840 Milliarden Dollar bewertet, aber die Sorge, ob das so bleibt, kann schnell schlaflose Nächte bereiten. Da ist der Pentagon-Deal ein willkommenes Heilmittel, vor allem wegen seines Door-Opener-Effektes für künftige Deals. Denn allein der mit Volldampf vorbereitete Einbau von Werbung in den Chatbot wird nicht die Rettung sein.

Wir werden die neuen Unternehmen der OpenAI-Abtrünnigen beobachten, mit der Hoffnung, dass die Zwänge eines Big-Money-Systems nicht immer über die Absichten der Menschen siegen.